L'Intelligence Artificielle ("IA") dans la production d'image, et son enseignement

Par Manuel Ruiz Dupont : consultant en process de développement temps réel et formateur à Pixelacademia

Cet article aborde le bouleversement que l'IA va engendrer dans le domaine de la production d'images. Même si vous n'êtes pas du métier, vous pourrez aisément le comprendre car j'illustre mon propos avec beaucoup d'exemples visuels (et je vous conseille dans un premier temps de regarder la vidéo de l'intervention de M. Villani, au Sénat, dans laquelle il aborde les limites de l'IA ).

L'IA c'est quoi ?

Il existe plusieurs types d'IA (ANI, AGI, ASI…), chacune ayant sa propre définition[1], mais je ne vais traiter que celles qui utilisent une base de données gérée par des algorithmes complexes. Il existe également des IA sans bases de données déjà constituées : celles-ci sont créées à l'instant "T" lors du lancement de l'ordre, ou bien se créent progressivement (Machine Learning).

On fait quoi avec l'IA ?

Aujourd'hui, il existe déjà beaucoup d'applications qui fonctionnent correctement avec l'IA.

Création d'images de très haute qualité, créées d'après un texte ou un simple croquis

Image réalisée avec Google Colab (gauche) et Nvidia (droite)

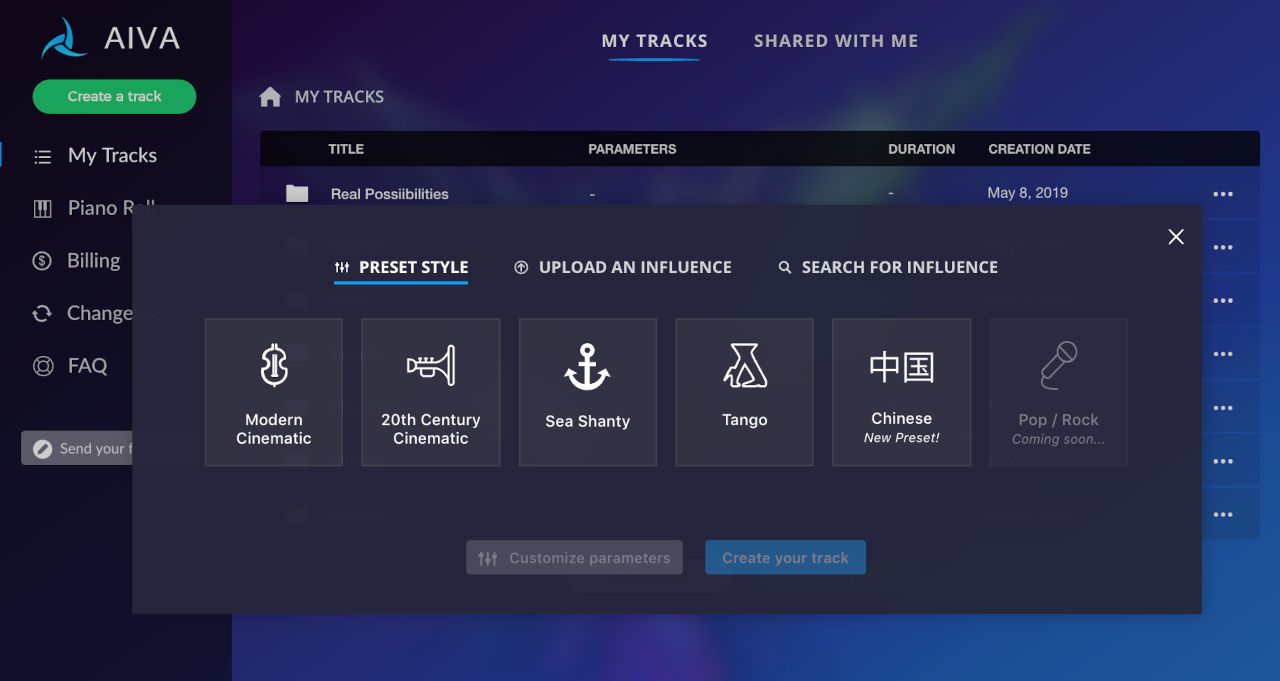

Possibilité de créer de la musique avec une interface très simple ou d'après un texte

Interface d'Aiva, logiciel de création musicale avec IA

Création automatique d'une histoire (les contes, notamment)

Possibilité d'avoir un game play "prémonitoire" des actions du joueur, dans le domaine des jeux vidéo

Le "Neural State Machine" présenté au salon Siggraph en 2019, est capable d'apprendre et de "prédire" les interactions entre le personnage (avatar) et la scène à partir de données de capture de mouvements en temps réel.

Un certain nombre d'applications ludiques qui utilisent exclusivement de l'IA sont également déjà commercialisées. Vous pouvez également les trouver gratuitement sur internet (Google Colab). Elles sont généralement programmées en Python, mais vous pouvez les utiliser sans savoir programmer.

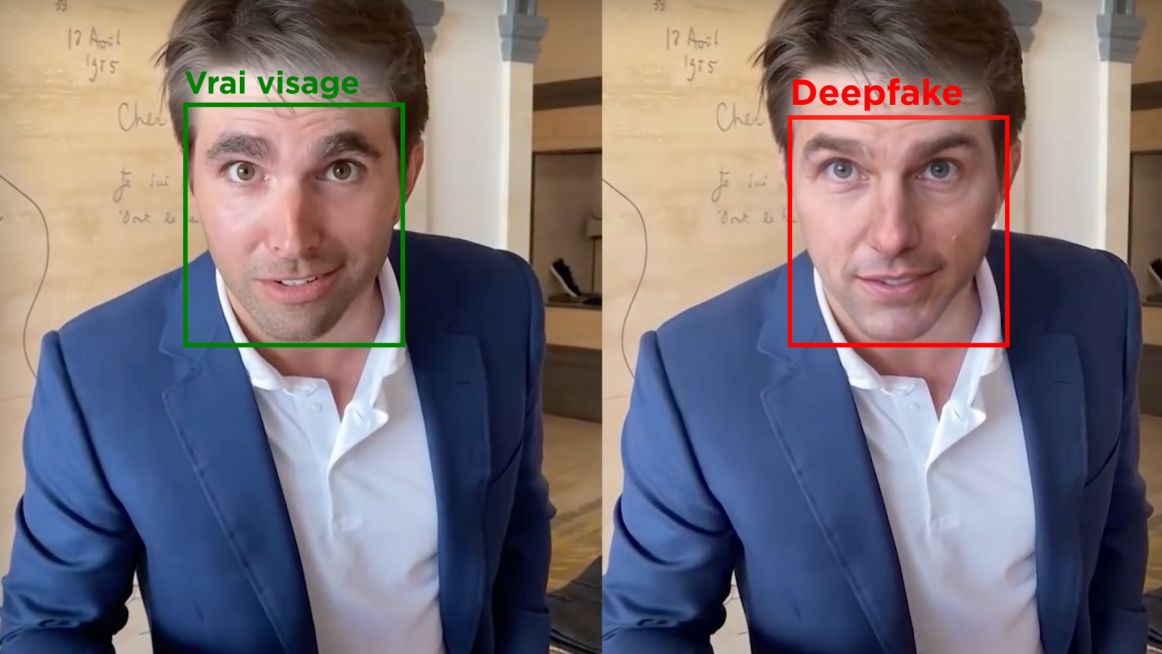

Voir son visage à la place d'un acteur dans une scène de film

Exemple de deepfake avec l'acteur Tom Cruise (à droite)

Possibilité de voir son visage dans 50 ans ou si on était une femme ou un homme ou d'une autre origine

Image générée d'après le soft d'IA Artbreeder

A cela s'ajoutent les applications qui ne sont encore qu'à l'état de recherche embryonnaire

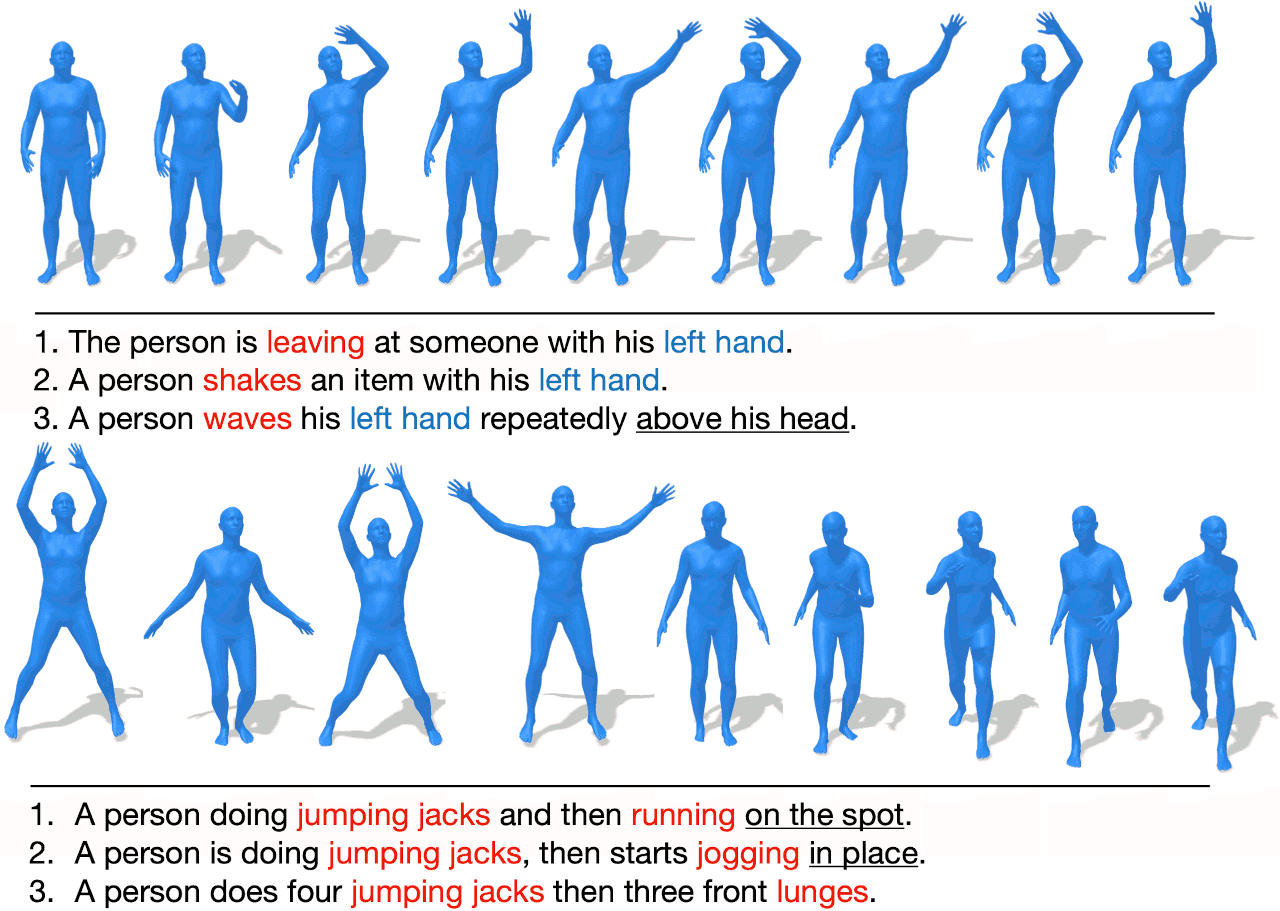

Génération de personnages en 3D, avec leur animation d'après un texte

HumanML3D précurseur de l'animation "textuelle"

Création de volumes en 3D d'après une seule photo

Et, bien sûr, il y a toutes ces applications que l'on aimerait que l'IA rende possible dès aujourd'hui, comme le Rig musculaire automatique, ou encore la création de vêtements hyper réalistes animables d'après un patron ou une simple photo, mais on va devoir encore attendre un peu.

L'IA dans la production d'images

Les logiciels d'IA actuels ne se positionnement pas comme des solutions aux problématiques de développement. Unreal Engine a mis plus de 6 ans - malgré ses énormes moyens - pour créer une transversalité relativement acceptable avec 3DSMax, Maya et Houdini, mais encore très faible pour Nuke. Par conséquent, si l'on considère arbitrairement l'année 2022 comme l'année zéro de l'IA, on va devoir encore patienter avant que l'IA soit véritablement appliquée dans la chaine de production d'images, et cela passera nécessairement par l'activation de plugins sur les logiciels de production et - parallèlement - par la naissance de logiciel d'IA qui prennent en compte les besoins des logiciels de production : l'IA s'imposera véritablement quand elle sera accessible sur le logiciel de production déjà installé.

Jusqu'à présent, si l'on travaillait dans le domaine du jeu vidéo, on ne devait maîtriser que quelques concepts techniques (UV, Bones, normales, polygones, shader) pour développer, mais l'augmentation de la puissance des machines a créé des ponts avec d'autres secteurs d'activité (le cinéma notamment) qui eux gèrent d'autres concepts (fluides, cheveux, rendus...). Je pense que l'IA va dans un premier temps permettre de créer des outils aux concepts techniques très puissants et faciles à utiliser grâce à des interfaces simples, et qui serviront aussi bien pour le cinéma que pour les métiers du temps réel.

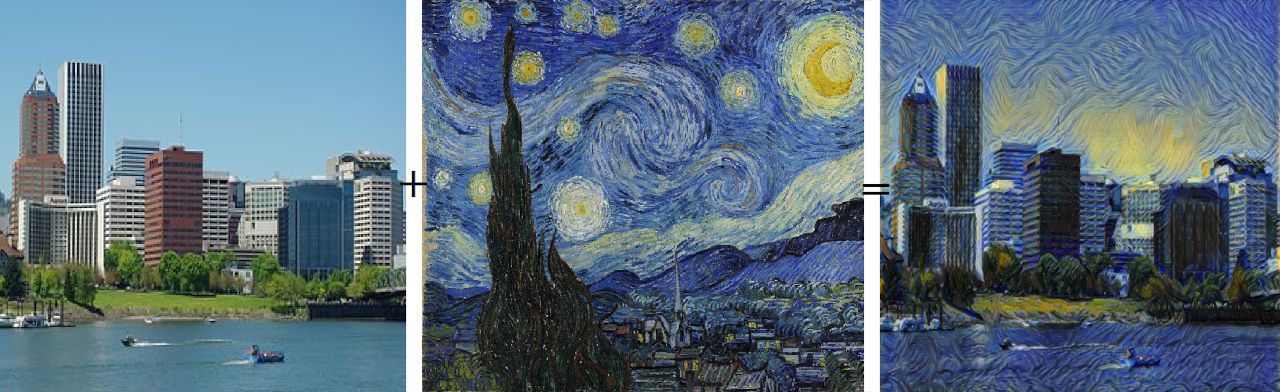

Dans un deuxième temps, l'IA va également permettre de produire rapidement des effets visuels ou des trucages qui demandaient beaucoup de temps de développement. Il s'agit notamment de la création de styles graphiques ou encore des fameux deepfake (c'est déjà possible, mais le résultat n'est pas assez précis ou qualitatif pour être mis en oeuvre dans une production).

Utilisation de divers modèles mathématiques pour le transfert de style artistique, ici la ligne d'horizon de la ville de Portland, dans le style de la nuit étoilée de Van Gogh

Est-ce la fin de certains métiers ? Personne ne le pense, mais Quixel, Kitbash3d, ou encore les banques de textures ont réduit considérablement les besoins humains d'une production, mais dans le même temps, la production visuelle a explosé et les besoins humains ne font d'augmenter.

A titre d'exemple, j'ai tenté de créer une animation 3D avec le moins d'intervention humaine possible.

Voici comment j'ai procédé :

- J'ai créé un texte avec un logiciel d'IA générateur de poèmes

- J'ai créé l'image avec un logiciel d'IA de création d'images d'après un texte (j'ai copié le texte créé par le logiciel de création de poèmes)

- J'ai créé le "volume 2D" avec un logiciel d'IA

- J'ai créé le volume 3D avec un logiciel de photogrammétrie

- J'ai exporté le volume dans Maya puis créé une cinématique avec un mouvement de caméra

- J'ai exporté le rendu dans un logiciel d'IA pour rendre l'animation plus homogène

Quel est l'avenir de l'IA ?

A l'heure actuelle, le plus grand frein à l'IA est le temps nécessaire à la création de la base de données et au traitement de celle-ci par des algorithmes.

Si l'on parvient à réduire ce temps, on peut imaginer que l'IA nous aidera en temps réel - tout au long du développement - à sublimer nos créations ou corriger nos erreurs. Si l'on associe cette IA temps réel à d'autres techniques (bibliothèque d'assets, création d'avatar…) qui vont énormément progresser, elles aussi, on peut imager sans trop de difficultés la création de films (avec dialogues et musique) ou de dessins animés, réalisés d'après un story board plus ou moins détaillé, où l'IA se contenterait de combler les vides d'après ses bases de données. Le créateur de ce film n'aurait plus qu'à modifier certains détails du résultat, selon sa vision, à l'aide d'une interface assez simple. Je sais que cela peut ressembler à de la science fiction, à l'heure actuelle…

Bien sûr, beaucoup d'étapes devront être franchies avant d'arriver à une solution viable, mais plus on se rapprochera d'une création spontanée avec très peu de besoins humains, plus la problématique de l'originalité de l'oeuvre ressortira, car l'IA a besoin de bases de données. Or à l'heure actuelle, beaucoup d'entre elles sont constituées sans l'accord des auteurs.

Peut-on déjà imaginer la création de nouvelles entreprises qui commercialiseraient des bases de données d'images dont elles seraient les auteurs ? Et si, au final, l'un des avenirs possibles, pour les entreprises de développement, était simplement la création d'images destinées à constituer des bases de données ?

Quand passer à l'IA ?

Cela me rappelle cette période, il y a 4 ou 5 ans, où le temps réel a commencé à être utilisé dans d'autres secteurs d'activité que le jeu vidéo. Il a été perçu dans un premier temps comme la solution ultime à beaucoup de problématiques de développement. Dans certains cas, c'était vrai, mais dans d'autres non. Et souvent le temps réel a simplement offert plus de confort de création. Par exemple, le temps réel donne une réelle plus-value au video mapping, et dans le domaine du cinéma il offre un plus grand confort de mise en scène. Dans le domaine de l'animation, il permet de créer un process de développement plus souple, mais le rendu final perd en qualité.

Aujourd'hui'I, l'IA est déjà présente dans les phases de préproduction (elle est utilisée par les concept artists). Dans la phase de production, elle n'est clairement pas au point ou reste anecdotique, mais je pense qu'elle sera bientôt présente dans la dernière phase (post production), notamment pour les réglages colorimétriques (DVinchi), car il existe déjà des milliers de bases de données qui permettent de l'utiliser rapidement.

Alors quand passer à l'IA ? Faut-il attendre que les logiciels soient enfin au point, sachant que la prochaine version sera toujours meilleure ? Au bout du compte, si l'on se montre prudent et que l'on dédie un peu de temps à la R&D et à la veille technologique, il n'y a pas de mauvais choix. Mais dans certains secteurs d'activité, la mise en oeuvre de l'IA sera plus rapide, notamment dans le domaine de la restauration de photos ou de vidéos (et sûrement, déjà, dans celui de la musique).

Restauration de photo réalisée avec Photoshop et un logiciel d'IA (stable diffusion).

Comment l'enseigner et pourquoi ?

Apprendre l'IA à un graphiste comme on lui enseigne Maya ou Blender me semble impossible car, en fin de compte, il s'agit de mathématiques. Or on ne va pas demander à un graphiste de programmer une IA. En revanche, on peut lui expliquer les concepts techniques qu'utilise l'IA et qui sont très éloignés des UV ou des fluides.

Ce qui est certain, c'est que la tendance suivante se dégage depuis plusieurs années : les entreprises recherchent des profils qui maîtrisent l'esthétique et la tech.

De nouveaux métiers vont apparaitre, et donc de nouveaux profils qui auront d'autres qualités que l'esthétique ou la tech et plutôt une forte disposition à l'abstraction afin de pouvoir manipuler les concepts tech de l'IA, sans être des virtuoses des mathématiques.

On doit déjà enseigner l'IA dans les écoles et chaque école doit identifier comment le faire car, à court terme, les entreprises demanderont des profils à l'aise avec les concepts d'IA.

Pour résumer

Je considère qu'à moyen terme, l'IA sera un véritable vecteur de bouleversement au sein de nos chaines de production, car les process de développement vont évoluer avec sa mise en oeuvre dans les logiciels que nous utilisons. L'enseignement de l'IA prendra une place à part entière dans les écoles de jeu vidéo et on la verra apparaitre dans de nouveaux cursus.

Bien entendu de nouveaux métiers et entreprises vont apparaitre. A très court terme le véritable frein se situe au niveau de l'éthique et des aspects juridiques. En effet, l'IA permet la création de contenus de très grande qualité susceptibles d'être condamnables sur le plan éthique. Par ailleurs, à l'heure actuelle, les bases de données sont probablement constituées sans l'accord des auteurs, ce qui pose un problème juridique.

Si vous êtes intéressé par l'aspect juridique et éthique de l'IA je vous conseille de lire l'interview que M. Emad Mostaque, fondateur de Stable Diffusion (logiciel d'IA) a accordée au Times.

Consultant en process de développement temps réel et formateur à Pixelacademia